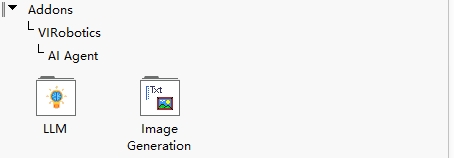

功能模块详解¶

AI Agent for LabVIEW 当前主要由两个核心模块构成:

LLMImageGeneration

这两个模块共同构成从“理解任务”到“生成结果”的完整能力闭环。

模块总览¶

在典型工作流中:

LLM负责理解用户意图、组织上下文、调用工具、图像理解与结果输出ImageGeneration负责图像生成与图文融合处理(也可被LLM作为工具调用)生成结果可回传给

LLM继续进入下一步任务编排

可以理解为:

LLM是“大脑”(理解、决策、图像理解与输出编排)ImageGeneration是“图像生成执行器”(生成与融合处理)

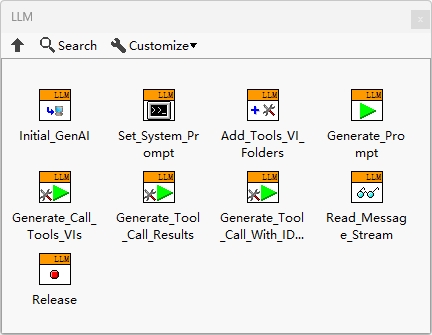

模块 1:LLM¶

LLM 模块负责大语言模型相关能力,是 Agent 的核心入口。

主要能力¶

多模型服务商接入与切换、流式输出

意图理解与多轮上下文管理

工具调用(Function Calling)

图像理解(对输入图片进行描述、分析与解释)

结构化返回、任务分解与结果输出

典型输入¶

用户自然语言指令

会话历史(上下文)

图片输入(用于图像理解任务)

工具列表及工具描述

模型参数(如温度、最大输出长度等)

典型输出¶

文本回复

图像理解结果(描述、要点、分析结论)

工具调用请求(含参数)

结构化结果与最终输出(用于后续流程处理)

适用场景¶

智能问答与工程助手

文档理解与摘要

图像内容理解与解释

LabVIEW 工程说明生成

多步骤任务编排与执行

网络搜索与代码生成

模块 2:ImageGeneration¶

ImageGeneration 模块负责图像生成与融合能力,支持文生图、图生图与图文融合等任务。

使用前置条件(重要)¶

当前 ImageGeneration 主要基于豆包模型能力,请在使用前完成以下准备:

在火山引擎开通豆包相关服务,并启用

doubao-seedream模型在 Agent 中完成豆包 API 配置(接入点 ID 作为 API Key 使用)

安装仪酷智能视觉工具包

AI Vision Toolkit for GPU,工具包下载入口:https://www.virobotics.net/product_AIVT_GPU确认本机环境满足视觉工具包运行要求

主要能力¶

文生图:根据文本提示生成图像

图生图:基于输入图像做风格迁移、重绘或变体生成

图文融合:结合图片与文本指令进行编辑、增强或内容补全

典型输入¶

文本提示词(目标内容、风格、约束)

输入图片(用于图生图或图文融合)

可选模型参数(尺寸、清晰度、比例、随机种子等)

典型输出¶

新生成或编辑后的图片文件

生成任务状态/结果信息(成功、失败、错误原因)

适用场景¶

实验流程示意图与说明配图生成(文生图)

已有图片的风格统一与版本迭代(图生图)

文档、报告、教学素材的图文协同制作(图文融合)

两大模块如何配合¶

推荐的最小闭环:

用户输入任务(例如“生成设备流程图并给出说明”)

LLM分析需求并生成图像提示词LLM直接调用ImageGeneration工具生成图片LLM基于图片结果补充说明、输出最终答复

该模式适合逐步扩展为更复杂的多工具流程(如后续接入 VI 专项模块)。

开发建议¶

先单独验证

LLM对话链路,再接入ImageGeneration为图像生成定义统一提示词模板,方便团队复用

把模型、参数、工具描述做成配置项,避免写死在框图逻辑中

对关键节点增加错误处理(超时、配额不足、参数非法)

功能分类与详细说明¶

以下内容提炼自发布文档中的“功能分类与详细说明”,用于补充当前模块定义。

A. LLM 能力分类¶

1) 交互与理解能力¶

多模型灵活接入:支持多家主流模型服务商统一接入与切换

上下文对话:支持多轮会话与上下文管理

流式输出:支持实时逐字返回,提升交互反馈速度

图像理解:可对输入图片进行描述、分析与解释

2) 执行与编排能力¶

工具调用(Function Calling):可调用用户编写的 VI 工具完成任务

任务分解与结构化输出:支持把复杂需求拆解为可执行步骤

结果输出编排:支持“文本结果 + 工具结果”的统一组织与返回

3) 扩展与工程能力¶

多智能体协作:支持多个 Agent 并行或协同处理复杂任务

低代码可视化开发:沿用 LabVIEW 图形化开发模式,降低接入门槛

预置范例:支持从基础对话到综合工具调用流程的快速验证

B. ImageGeneration 能力分类¶

ImageGeneration 主要负责图像生成与图文融合处理,并可由 LLM 作为工具调用。

文生图:根据文本提示生成图片

图生图:基于输入图片生成变体、重绘或风格化结果

图文融合:结合图像与文本约束进行定向编辑与增强